आपल्याकडे एक मोठं नवं विद्यापीठ तयार झालंय भाऊ!! त्याचं नांव आहे व्हॉटसॲप आणि सोशल मिडिया विद्यापीठ. कुणीही सोम्यागोम्या उठतो, आणि तिथं आपले ज्ञानकण उधळतो आणि बाकीची जनता तेच खरं मानून माहिती पुढे पाठवत बसते.

तरी आतापर्यंत फोटोशॉप केलेले फोटो गैरसमज पसरवायचे. मग त्यात कधी इस्तंबूलमधले भारताबद्दलचे फोटो असतात, कधी जपानमधल्या ट्रेन्स अहमदाबादमधले म्हणून दाखवणारे फोटो असतात तर कधी कुठल्या हिरॉईनचं डोकं दुसऱ्याच कुठल्या उघड्यावाघड्या बाईच्या अंगावर चिकटवून 'जे नसतं ते दाखवणारे' फोटो लोक शेअर करत असायचे.

पण आता हे आणखी पुढच्या लेव्हलला गेलंय भाऊ. आता चक्क एखाद्या माणसाचा खोटा व्हिडिओ तयार करता येत आहे. जर एखाद्या व्यक्तीचे बरेचसे फोटो-व्हिडिओज आणि त्या व्यक्तीसारखा हुबेहूब आवाज तुमच्याकडे असेल, तर त्या व्यक्तीनं काहीही म्हटल्याचा खोटा व्हिडिओ तुम्हांला तयार करता येणार आहे.

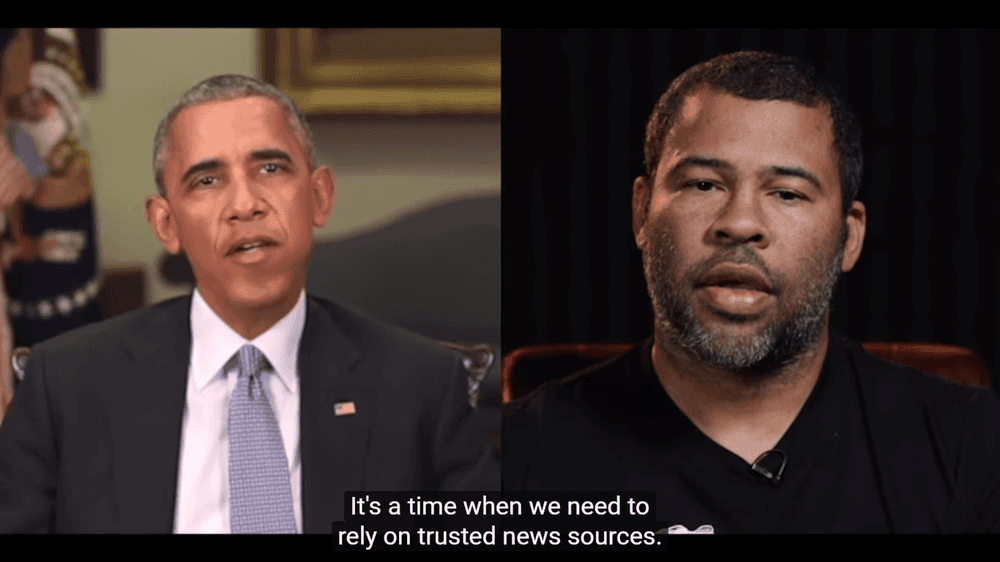

खात्री करुन घ्यायची असेल तर हा व्हिडिओ पाहाच.. या व्हिडिओमधले ओबामा खरे नाहीयेत बरं.. त्यांच्या तोंडून खरंतर अमेरिकन ॲक्टर-कॉमेडियन जॉर्डन पील बोलत आहेत. ओबामा या व्हिडिओत जे काही बोलत आहेत असं दाखवलं आहे, त्या गोष्टी ते कधीच उघडपणे कॅमेऱ्यासमोर बोलणार नाहीत.

हे कसं शक्य आहे?

मंडळी, हे आहे ए. आय. म्हणजेच आर्टिसफिशियल इंटेलिजन्स. म्हणजेच कृत्रिम बुद्धीमत्ता. या क्षेत्रात सध्या मशीन लर्निंग म्हणजेच कंप्युटरला एखादं काम कसं करायचं हे शिकवण्याच्या गोष्टीची फारच चलती आहे. वेगवेगळे अल्गोरिदम्स वापरुन यात अधिकाधिक अचूकता आणता येते.

तर, हे मशीन लर्निंग वापरुन डीपफेक नावाचं एक तंत्रज्ञान बनवलं गेलंय. हे डीपफेक करतं काय, तर फोटोज आणि व्हिडिओज दुसऱ्या फोटो आणि व्हिडिओजवर इतक्या बेमालूमपणे चिकटवतं की तो व्हिडिओ खरा की खोटा हे कळणंच मुश्किल होईल. आजवर लोक हे डीपफेक तंत्र वापरुन लोक सेलेब्रिटींचे किंवा ब्रेक-अप झालेल्या गर्लफ्रेंडचे अश्लील व्हिडिओज बनवायचे. फक्त त्यासाठी तुमच्याकडे ज्या व्यक्तीचा खोटा व्हिडिओ बनवायचा आहे, त्याचे पुष्कळ फोटोज आणि व्हिडिओज असायला हवेत.

आता मिडियामध्ये बराक ओबामाबद्दल इतकी फोटोग्राफिक माहिती आहे, की असा व्हिडिओ बनवणं काहीच अवघड नव्हतं. बझफीडचे व्हिडिओ प्रोड्युसर जरेड सोसांनी नेमकं हेच केलं. मात्र ओबामांची अचूकता आणण्यासाठी त्यांना मशीनला ५६तास शिकवावं लागलं.

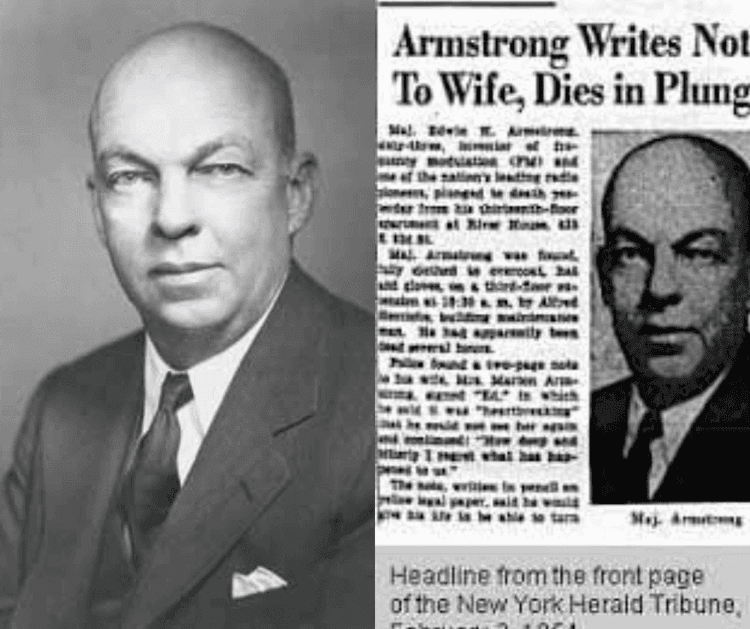

डीपफेकने बनवलेला हा आणखी फोटो..

अश्लील व्हिडिओ तयार करण्यासाठी वापरलेलं तंत्र आता राजकीय स्वार्थासाठीही वापरलं जाऊ शकेल. किंबहुना, शास्त्रज्ञांनी यावर आधीच संशोधनही चालू केलंय. २०१६ मध्ये त्यांनी जॉर्ज बुश, व्लादिमीर पुतीन आणि ओबामा यांच्या व्हिडिओजचे प्रयोग केले. नंतर फक्त ओबामांचे व्हिडिओज तयार करुन त्यावरही संशोधन केलं. पण या लोकांचं म्हणणं होतं की तुम्ही कुणाचाही आवाज वापरुन असे खोटे व्हिडिओ तयार करु शकणार नाही. दुर्दैवानं म्हणा किंवा काहीही, कारण त्यानंतर सहाच महिन्यांत डीपफेकचा जन्म झाला आणि आताखरंच तुम्ही कुणाचाही आवाज घेऊन खोटे व्हिडिओ तयार करु शकता.

जिथं फोटोशॉप केलेल्या फोटोंवर डोळे झाकून विश्वास ठेवणारी जनता आहे, तिथं कुठला व्हिडिओ खरा आणि कुठला खोटा हे ठरवणं अवघड असेल, तर काय होईल हे तुम्हीच आता बघा. हा धोका केवढा मोठा आहे हे पुढच्या निवडणूकांमध्ये लोकांच्या जास्त लक्षात येईल.

पूर्वी आपण म्हणायचो की डोळ्यांत आणि कानांत चार बोटांचं अंतर असतं. त्यामुळं ऐकलेलं तेच खरं असेल असं म्हणता येत नाही. पण आता पाह्यलेलं पण खरं असेल की नाही याची शाश्वती देता येत नसेल तर?? कलीयुग हो कलीयुग!!